728x90

vectorization으로 코드상의 for loop를 줄이고 big dataset에 대해 더 효율적인(빠른) 계산이 가능하도록 한다.

vectorization으로 for loop로 적은 코드를 더 효율적으로 만들 수 있다.

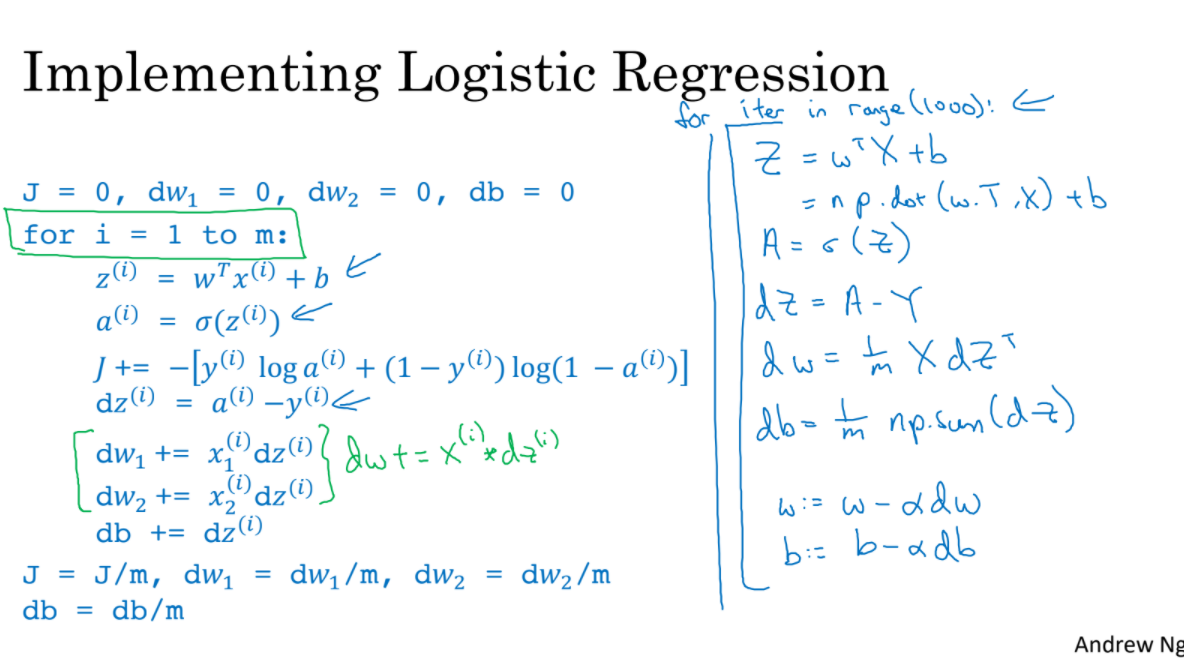

forward propagation 과정을 vectorization으로 표현해 보자.

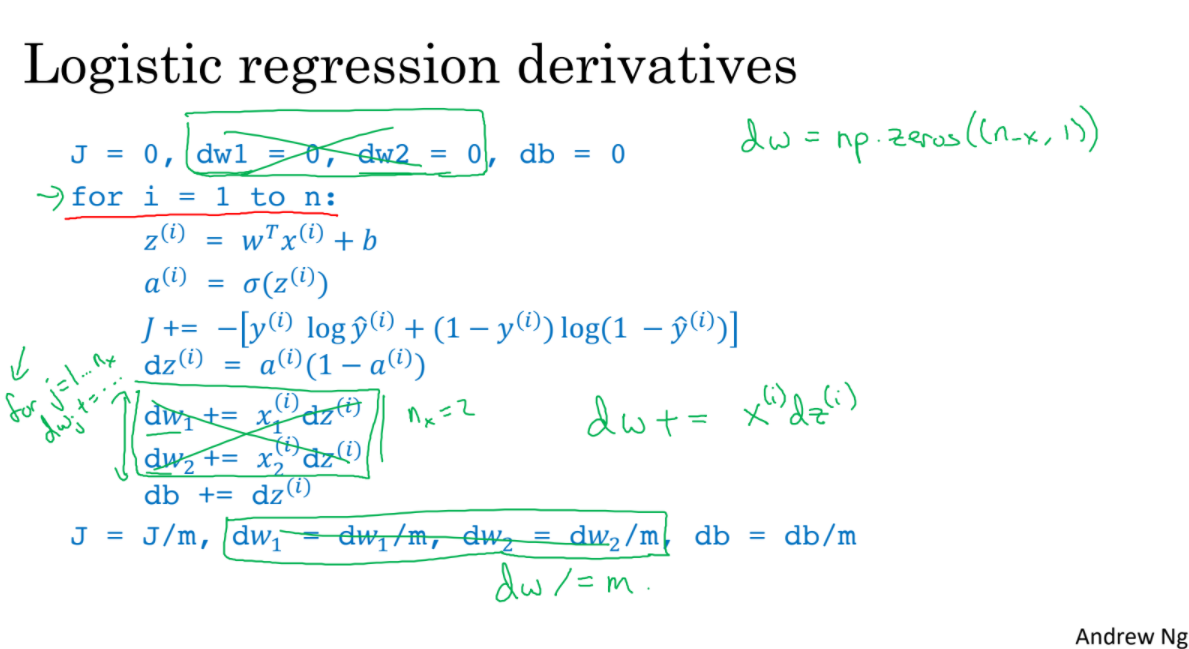

backward propagation 과정을 vectorization으로 표현해 보자.

broadcasting으로 python code를 더 빠르게 할 수 있다. for loop 없이 matrix 연산을 더 빠르게 구할 수 있다.

3 by 4인 A를 1 by 4인 cal로 나누는 것은 broadcasting으로 구현한 코드이다.

broadcast의 다른 예를 보여준다.

a = np.random.randn(3)

//(0.1, 0.2, 0.3)

// shape (3,)

a = np.random.randn(3,1)

// ( 0.1

// 0.2

// 0.3 )

// shape (3,1)참고로 matrix를 정의할 때(특히 rank 1 array의 경우) 후자의 방법을 권장한다. 에러의 위험성도 줄고 더 명확한 표현이 가능하다.

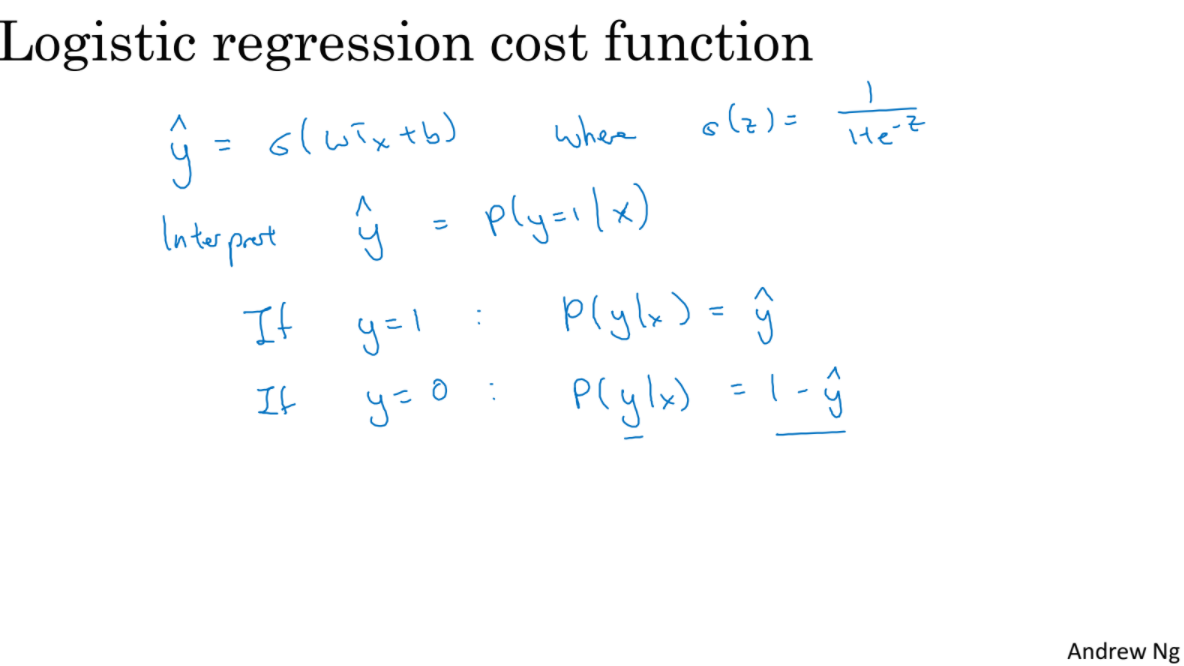

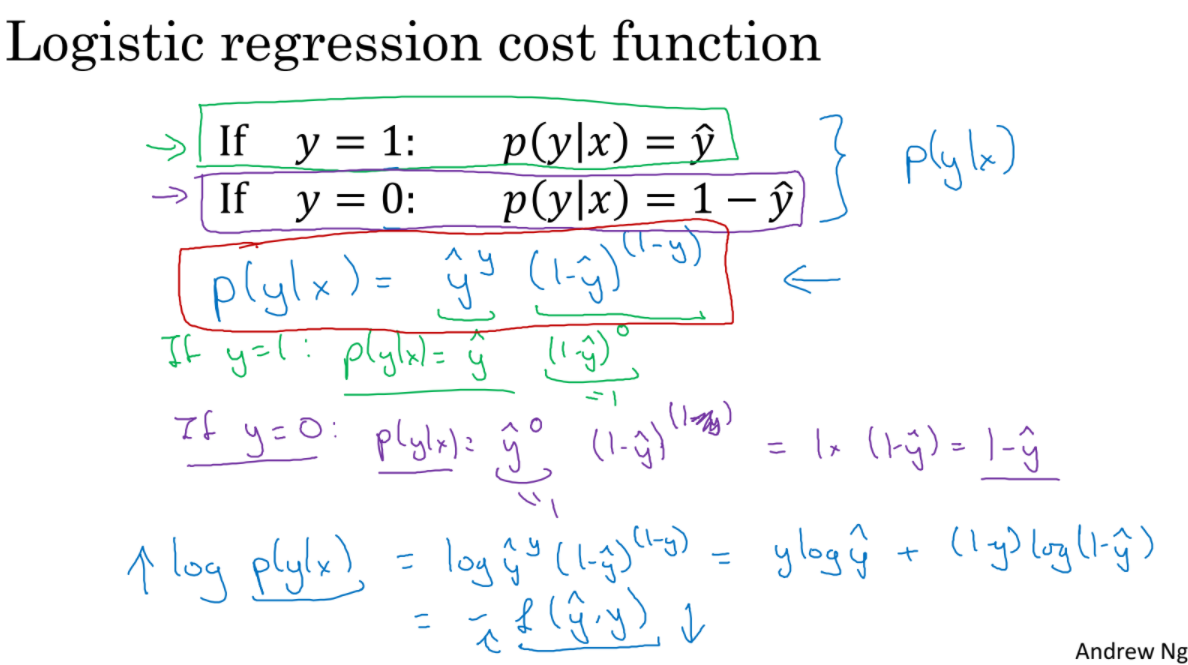

explanation of logistic regression cost function

728x90

반응형

'ComputerScience > Machine Learning' 카테고리의 다른 글

| Deep Learning 1-3-1 (0) | 2021.09.10 |

|---|---|

| AI - 2. Search (0) | 2021.09.09 |

| Deep Learning 1-2-1 (0) | 2021.09.07 |

| Deep Learning 1-1 (0) | 2021.09.07 |

| AI - 1. Artificial Intelligence (0) | 2021.09.02 |